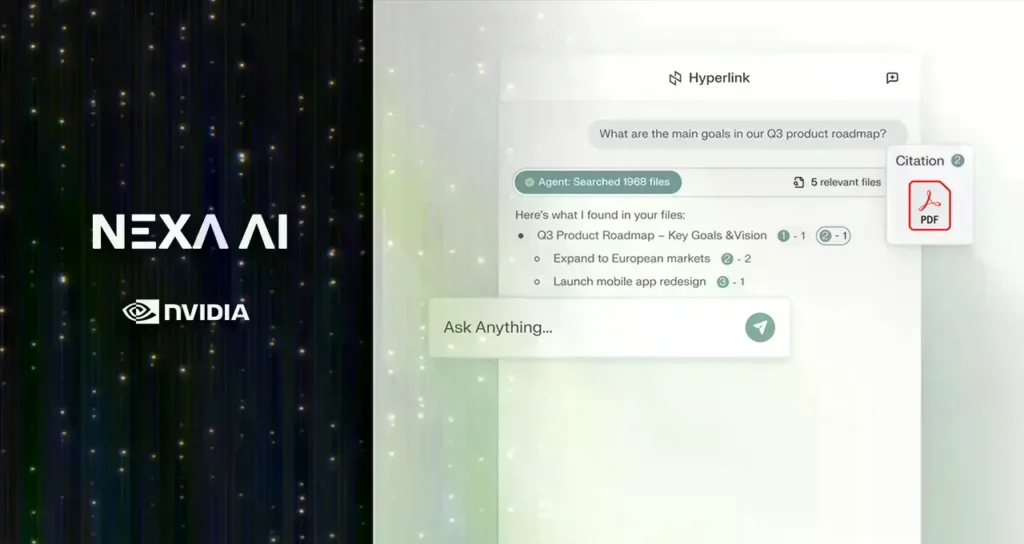

Hyperlink acelera indexación y respuestas en ordenadores NVIDIA RTX

Triplica la velocidad de indexación y duplica la inferencia de modelos de lenguaje. La nueva versión del agente de IA local Nexa.ai aprovecha la aceleración por hardware para procesar datos de usuario de forma más rápida y privada.

Búsqueda contextual acelerada

Hyperlink indexa miles de archivos locales y comprende la intención de las consultas en lenguaje natural. Todo el procesamiento se realiza en el dispositivo, manteniendo los datos privados sin enviarlos a la nube.

Optimización para RTX

La integración con NVIDIA RTX reduce el tiempo de indexación de 15 a 5 minutos para carpetas de 1 GB. La inferencia de LLM se acelera al doble, proporcionando respuestas más rápidas a las consultas de los usuarios.

Transformación de datos en inteligencia

El agente combina búsqueda y capacidades de razonamiento de modelos de lenguaje acelerados. Conecta ideas entre fuentes, identifica relaciones entre documentos y genera respuestas con citas claras.

Casos de uso profesional

Hyperlink es utilizado por profesionales, estudiantes y creadores para preparar reuniones, analizar informes, crear contenido, estudiar, organizar recibos y depurar código. Accede a información relevante sin depender de coincidencias de palabras clave.

Antecedentes de la tecnología

Los asistentes de IA basados en LLM son herramientas de productividad potentes, pero sin el contexto adecuado pueden tener dificultades para proporcionar respuestas relevantes. Hyperlink aborda este desafío indexando archivos locales para ofrecer información contextual.

Implicaciones del desarrollo

La aceleración hardware en plataformas NVIDIA RTX permite procesamiento local más eficiente de grandes volúmenes de datos. Esta evolución facilita el acceso a información personalizada manteniendo la privacidad de los datos en el dispositivo.