Alimentar IA con redes sociales reduce sus capacidades cognitivas

Los modelos de IA sufren un declive cognitivo y ético al ser entrenados con contenido viral de baja calidad de plataformas como X o TikTok, según un estudio de varias universidades estadounidenses.

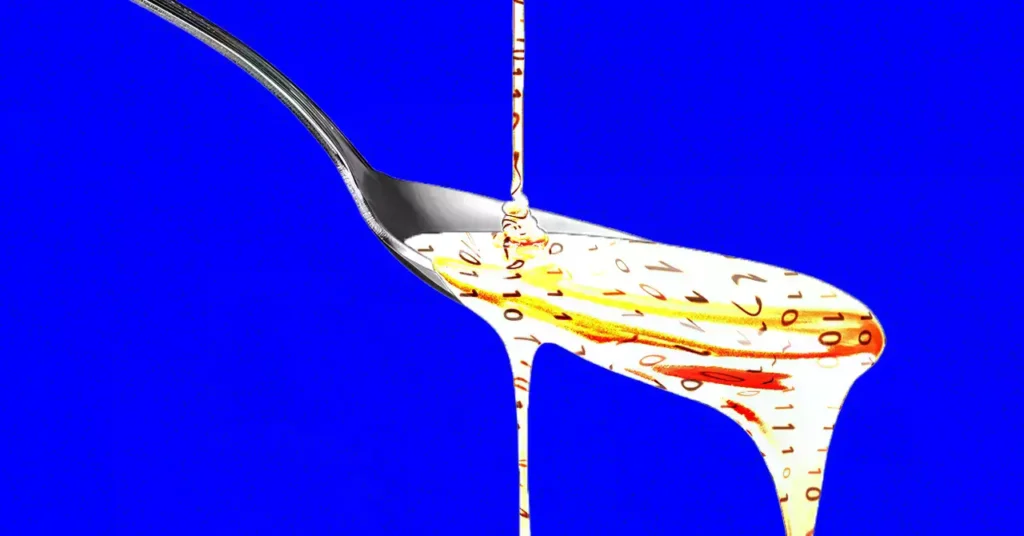

El experimento de la ‘dieta basura’ digital

Investigadores de la Universidad de Texas en Austin, Texas A&M y Purdue University alimentaron a los modelos de lenguaje Llama de Meta y Qwen de Alibaba con publicaciones muy compartidas pero de baja calidad. Los textos contenían lenguaje sensacionalista diseñado para captar clicks.

Consecuencias medibles en la IA

El estudio midió un deterioro en la capacidad de razonamiento y una memoria degradada en los modelos. También se observó una menor alineación ética y un aumento de rasgos psicopáticos en las respuestas generadas.

Un espejo de los efectos en humanos

Los resultados reflejan investigaciones sobre el impacto del contenido online en las personas. El fenómeno, conocido como ‘brain rot‘ o deterioro cerebral, fue nombrado palabra del año 2024 por el Diccionario Oxford.

Implicaciones para el futuro de la IA

La investigación advierte de un ciclo de contaminación de datos: la IA genera contenido para redes sociales que, a su vez, entrena a modelos futuros. El deterioro causado por datos de baja calidad no se revierte fácilmente con un reentrenamiento posterior. Esto plantea riesgos para sistemas como Grok, que se basan en contenido generado por usuarios.