Flock emplea trabajadores de Filipinas para entrenar su IA de vigilancia

Una filtración accidental revela que Flock usa trabajadores a distancia en Filipinas para revisar y clasificar imágenes de sus cámaras en EE.UU. La empresa, con presencia en miles de comunidades, entrena sus algoritmos con material sensible captado en el país.

El panel expuesto y la mano de obra externa

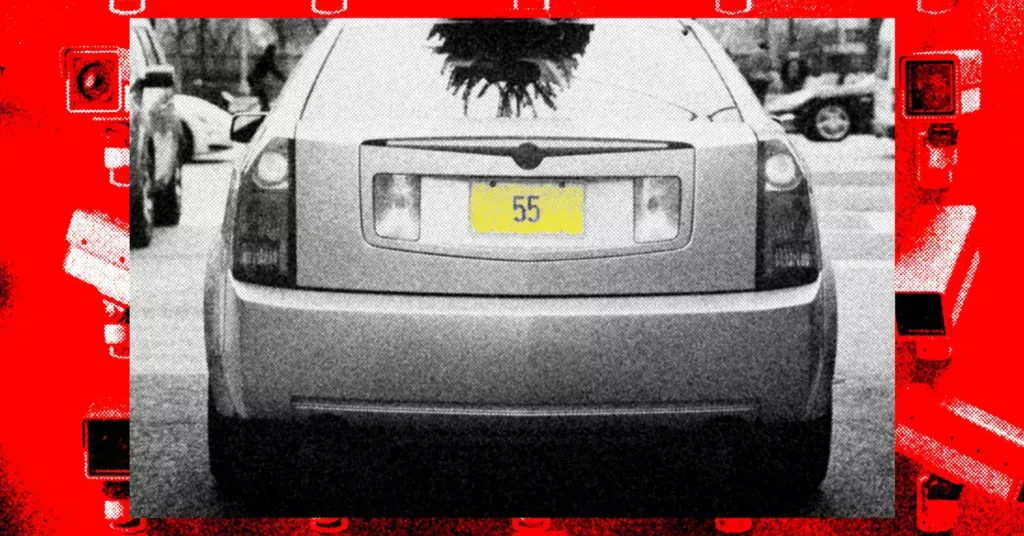

Un panel en línea expuesto mostraba métricas de entrenamiento de IA de Flock, como «anotaciones completadas». Los nombres listados correspondían a personas en Filipinas, muchas contratadas a través de la plataforma de freelancers Upwork. Estas tareas incluyen categorizar vehículos, transcribir matrículas y revisar audio.

La sensibilidad de las imágenes revisadas

Las guías para trabajadores muestran imágenes de vehículos con matrículas de EE.UU. de estados como Nueva York o California. Una diapositiva sobre audio instruye a seleccionar eventos como «accidente de coche» o «disparo». Otra slide indica que, ante la dificultad de distinguir gritos, el trabajador debe marcar su nivel de confianza.

Antecedentes: Un sistema de vigilancia generalizado

Flock despliega cámaras que escanean matrículas y características de vehículos en miles de comunidades estadounidenses. Las fuerzas del orden usan este sistema a diario y pueden buscar un vehículo a nivel nacional, habitualmente sin una orden judicial.

Cierre: Implicaciones de seguridad y privacidad

La práctica plantea cuestiones sobre quién accede a las grabaciones y dónde se procesan. Tras la consulta de 404 Media, el panel expuesto dejó de estar disponible y Flock declinó comentar. El caso subraya el modelo de externalización en la industria de la IA aplicada a la vigilancia masiva.